연합뉴스#전북의 한 방송사 아나운서인 20대 여성 A씨는 최근 곤욕을 치렀다. 평소 자신의 일상을 올리는 SNS에서 누군가 허락 없이 사진을 끌어다 본인의 SNS 계정에 합성된 게시물을 올렸기 때문이다. 해당 계정의 게시물에는 A씨의 사진을 합성해 포옹하는 사진 등 수십 개의 불법 게시물이 게재됐다.

연합뉴스#전북의 한 방송사 아나운서인 20대 여성 A씨는 최근 곤욕을 치렀다. 평소 자신의 일상을 올리는 SNS에서 누군가 허락 없이 사진을 끌어다 본인의 SNS 계정에 합성된 게시물을 올렸기 때문이다. 해당 계정의 게시물에는 A씨의 사진을 합성해 포옹하는 사진 등 수십 개의 불법 게시물이 게재됐다.

#지난달 서울 관악경찰서는 성폭력처벌법상 허위 영상물 유포 등의 혐의로 20대 남성 B씨를 입건해 조사 중이라고 밝혔다. 경찰에 따르면 B씨는 피해자의 사진과 음란물을 합성한 딥페이크 게시물을 게재했다. 이후 게시물 제작자라며 접근했고 삭제를 원하면 자신의 노예가 되라고 협박했다. B씨는 피해자의 고교 선배로 파악됐다.

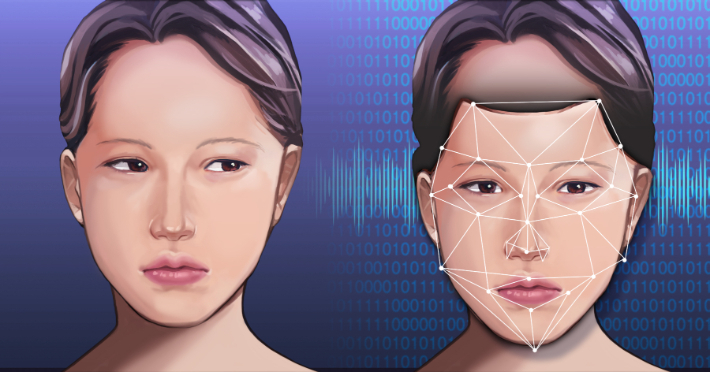

'n번방' 사태를 계기로 딥페이크 처벌법은 지난 2020년 6월 시행됐지만, 여전히 딥페이크 범죄가 기승을 부리고 있다. 연예인을 대상으로 한 이 같은 범죄는 점차 일반인까지 그 영역을 확장하고 있다.

딥페이크 성범죄 2년 새 20% 증가…일반인까지 영역 확장

성폭력처벌법에 따라 누군가의 얼굴이나 신체 등을 허위 성 착취물로 만들거나 배포하면 5년 이하 징역 또는 5천만 원 이하의 벌금에 처한다. 영리를 목적으로 이를 퍼뜨리면 죄가 가중된다.

하지만 법이 시행됐음에도 딥페이크 성범죄는 꾸준히 증가하고 있다. 경찰청에 따르면 지난해 1월부터 11월까지 총 146건의 허위 영상물(딥페이크) 유포 사건이 발생했다.

실제 시정 요구에 그친 사례까지 딥페이크 성범죄 사례까지 포함하면 2020년 548건에서 지난해 2723건까지 급증했다.

특히 연예인을 대상으로 하던 딥페이크 범죄는 점차 영역을 넓히고 있다.

앞선 사례들처럼 지인을 대상으로 한 능욕성 범죄로 확장되고 있다. 지인이 SNS에 올린 사진 한 장으로도 손쉽게 진짜 같은 가짜 영상과 사진을 만들 수 있기 때문이다.

네덜란드 AI 연구소 센서티가 발간한 보고서에 따르면 텔레그램 기반 '딥페이크 봇'을 이용한 전세계 딥페이크 합성물 63%가 '가해자들이 실제로 알고 지내는 여성'을 합성한 것으로 조사됐다.

피해자 대부분은 여성이다. 경찰청이 확인한 인적 사항에 따르면 114명 중 여성이 109명(95.6%)이고 남성이 5명(4.4%)이다. 연령별로 살펴보면 10대 66명(57.9%), 20대 46명(40.3%)으로 10·20대 피해자가 98.2%에 이른다.

경찰 "제작자‧의뢰자 모두 처벌 가능"

경찰은 딥페이크 등 인터넷 발달로 늘어난 사이버성폭력에 대응하기 위해 전담반을 꾸리는 등 수사를 이어가고 있다.

단속 대상은 보안메신저·다크웹 등 성 착취물 불법유통망을 비롯해 불법촬영물과 불법합성물 등을 제작·유통하는 공급자와 이를 구매·소지·시청하는 이용자다.

딥페이크 피해자는 불법합성물 등을 게시하거나 소지하고 있다는 사실을 인지하면 청 사이버수사대 내 성폭력전담반에서 수사를 의뢰할 수 있다.

일반적으로 민‧형사상의 조치가 이뤄지며 민사상의 초상권침해금지와 형사상의 정보통신망법상 명예훼손으로 절차가 진행된다.

전북경찰청 관계자는 "게시는 물론 딥페이크 등 불법합성물을 가지고만 있어도 처벌이 가능하다"며 "피해자가 성적 수치심을 느꼈는지 등 추가 조사가 이루어지게 된다"고 설명했다.

이어 "상시 전담반이 운영되고 있으며 딥페이크를 의뢰받아 제작한 제작자까지 모두 처벌 대상이다"고 덧붙였다.

연합뉴스

연합뉴스삭제 오롯이 피해자 몫…"기술적 예방해야"

한국여성정책연구원이 발간한 '기술매개 성폭력 대응을 위한 법제 정비 방안'에 따르면 불법합성물로 피해를 입은 피해자들이 유포된 제작물을 삭제하는 데 어려움을 겪고 있다.

한번 온라인에 유포된 제작물은 끝없이 복제돼 다양한 형태로 보존이 되기 때문이다.

정부 차원에서 삭제 요청 지원과 모니터링을 실시하고 있지만, 속도와 양을 따라잡는 데 한계가 명확하다.

피해자 중 일부는 디지털 장의사를 고용하기도 하지만, 이에 대한 금전적 지원은 없는 실정이다.

실제 금전적 지원이 이뤄진다하더라도 전문성과 신뢰성이 담보되지 않은 사설 디지털 장의사를 통해 2차 피해가 발생할 수도 있는 부분이다.

이에 대해 이은의 변호사는 "국가 차원에서 금전적인 지원이 아닌 기술적으로 디지털 관련 성범죄를 온라인상에서 차단할 수 있는 기관이 필요하다"고 말했다.

이어 "피해자에게 지원해주는 소액의 금액은 실효성이 떨어진다"며 "피해자에게 지원이 되더라도 피해자가 신뢰성이 떨어지는 디지털 장의사를 고용할 가능성도 높다"고 덧붙였다.

업계 관계자는 "현행법에는 AI를 악용하여 심각한 정신적, 금전적 피해를 주는 것에 대한 명확한 규정이 없다"며 "AI를 악용한 범죄를 예방하고 큰 피해를 막기 위해 온라인상에서 기술의 사용을 제한하거나 중지할 수 있게 해야 한다"고 말했다.